Un dispositivo innovador permite a una mujer con tetraplejia “hablar” después de 18 años sin poder vocalizar.

Un equipo científico de la Universidad de California en Berkeley y San Francisco ha desarrollado un innovador dispositivo que convierte la actividad cerebral en habla audible casi en tiempo real, lo que ha permitido a una mujer de 47 años con tetraplejia ‘hablar’ por primera vez en 18 años. Este avance podría transformar la vida de personas con parálisis grave que afectan la capacidad de hablar.

El sistema, basado en inteligencia artificial (IA), resuelve uno de los mayores problemas de las neuroprótesis del habla: la latencia, o el tiempo de retraso entre el pensamiento de una persona y la producción del sonido. Gracias a los avances en IA, los investigadores han diseñado un método de transmisión que convierte las señales neuronales en habla clara y fluida sin los largos retrasos que caracterizaban las tecnologías anteriores.

Gopala Anumanchipalli, co-investigador principal del estudio, destacó que el enfoque de “streaming” utilizado en este dispositivo se inspira en la decodificación rápida del habla utilizada en asistentes como Alexa y Siri. “Podemos descodificar los datos neuronales y, por primera vez, hacer posible una transmisión de voz casi sincrónica, lo que resulta en una síntesis del habla más natural”, afirmó.

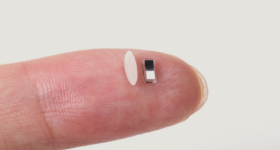

El ensayo clínico implicó la implantación de una interfaz cerebro-computadora en una mujer que había sufrido un accidente cerebrovascular, lo que le había impedido hablar o vocalizar durante casi dos décadas. Para entrenar el algoritmo, los investigadores le pidieron a la paciente que intentara pronunciar frases internamente, y a partir de ahí entrenaron una red neuronal utilizando la actividad cerebral registrada por electrodos en su corteza sensomotora del habla.

El sistema no solo descodifica las señales cerebrales relacionadas con la intención de hablar, sino que también reproduce el audio imitando la voz de la paciente, previamente entrenada con grabaciones anteriores a su lesión. Este avance, logrado por los equipos de Edward Chang y Gopala Anumanchipalli, tiene el potencial de mejorar significativamente la calidad de vida de personas con parálisis severas, permitiéndoles recuperar la capacidad de comunicarse a través del habla.

El nuevo dispositivo supera las limitaciones de los sistemas anteriores, que tenían una latencia de hasta 8 segundos para la descodificación de una sola frase. Con este avance, el habla se produce casi de forma inmediata, reflejando lo que la persona intenta expresar en tiempo real.

El equipo de investigación también probó la capacidad del sistema para generar palabras fuera del vocabulario entrenado, como términos del alfabeto fonético de la OTAN, demostrando que el modelo está aprendiendo los componentes fundamentales del sonido, y no solo repitiendo patrones preestablecidos.

Este avance, que se publica en la revista Nature Neuroscience, abre nuevas posibilidades para las neuroprótesis del habla y el uso de la IA en interfaces cerebro-ordenador, acercando a las personas con discapacidades graves a una mayor autonomía y comunicación efectiva.