Los criminales están mejorando sus campañas con inteligencia artificial, por lo cual hay fuertes alertas: IBM

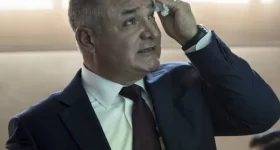

Los equipos de ciberseguridad y la población en general deberán tener cuidado este año porque el cibercrimen continuará usando herramientas de inteligencia artificial (IA) para mejorar sus campañas maliciosas. De acuerdo con Bruno Pancica, gerente de IBM Security en México, la inteligencia artificial no cambiará al cibercrimen de forma inminente, pero sí ayudará a que escalen sus ataques.

Esto porque dicha tecnología puede hacer más fácil el desarrollo de ciertas campañas maliciosas, por ejemplo, el phishing, que sirve para que el pirata informático se haga pasar por una marca o empresa conocida y así ganar la confianza de la víctima. Dicho método de ataque es aún más peligroso este año porque se realizarán eventos globales como los Juegos Olímpicos de París o elecciones presidenciales, momento que los ciberdelincuentes utilizan para lanzar phishing o hasta noticias falsas.

Adicionalmente, los piratas informáticos pueden utilizar ciertos modelos de inteligencia artificial para identificar víctimas potenciales y realizar una campaña maliciosa personalizada. El experto también consideró que esta tecnología provocará que, en el corto plazo, se tenga un ataque similar al Gusano de Morris, el cual fue el primer código malicioso autorreplicable. Esto significa que los ciberdelincuentes lograrán hacer un código malicioso a través de la inteligencia artificial capaz de escalar en la red y/o los dispositivos.

Sin olvidar que una gran cantidad de empresas están comenzando a utilizar la inteligencia artificial generativa, lo que los obliga a poner sus datos clave en un único repositorio y se genera un riesgo con relación a quién accede a éste. Esto coincide con lo observado en el Cisco 2024 Data Privacy Benchmark Study, el cual encontró que una de cada cuatro organizaciones en el mundo está prohibiendo el uso de la inteligencia artificial generativa justamente por los riesgos en la privacidad y seguridad de datos.

A lo que se añade que 48% de los encuestados admitió haber introducido información no pública de la empresa en ese tipo de herramientas.